Nature子刊 | 零通信也能多机协同?可微分物理驱动的视觉端到端高速飞行

试着把画面拉近,无论是在密林,还是在障碍物密集的室内,几架小型无人机,在无建图、无通信条件下连续穿越。这不是概念短片,而是登上Nature Machine Intelligence的真实成果。

2025年6月,上海交通大学林巍峣与邹丹平教授团队,发表论文 “Learning vision-based agile flight via differentiable physics”

首次将可微分物理训练的端到端策略部署到真实无人机,在林地实现单机20m/s的高速避障,并在零通信条件下完成六机复杂协同穿越。

来源:https://www.youtube.com/watch?v=LKg9hJqc2cc

文末附有论文与开源代码链接,方便您一键直达。如果本文对您有所帮助,欢迎在文末三连:点赞、转发和推荐,支持我们继续创作更多优质内容!

研究背景

在复杂、动态和未知环境中实现高速自主飞行仍然是空中机器人的难题。传统的级联式方案将任务分拆为定位、建图、规划和控制多个阶段,随着速度提升,系统时延和误差累积会放大,定位与建图本身在高速下也更易失稳且计算开销高,这些因素共同限制了系统在真实场景中的机动性与鲁棒性。

近年的端到端视觉避障策略表现亮眼,但强化学习往往样本效率低、对大规模并行环境依赖强,模仿学习又受制于专家示范的覆盖范围,泛化能力有限。

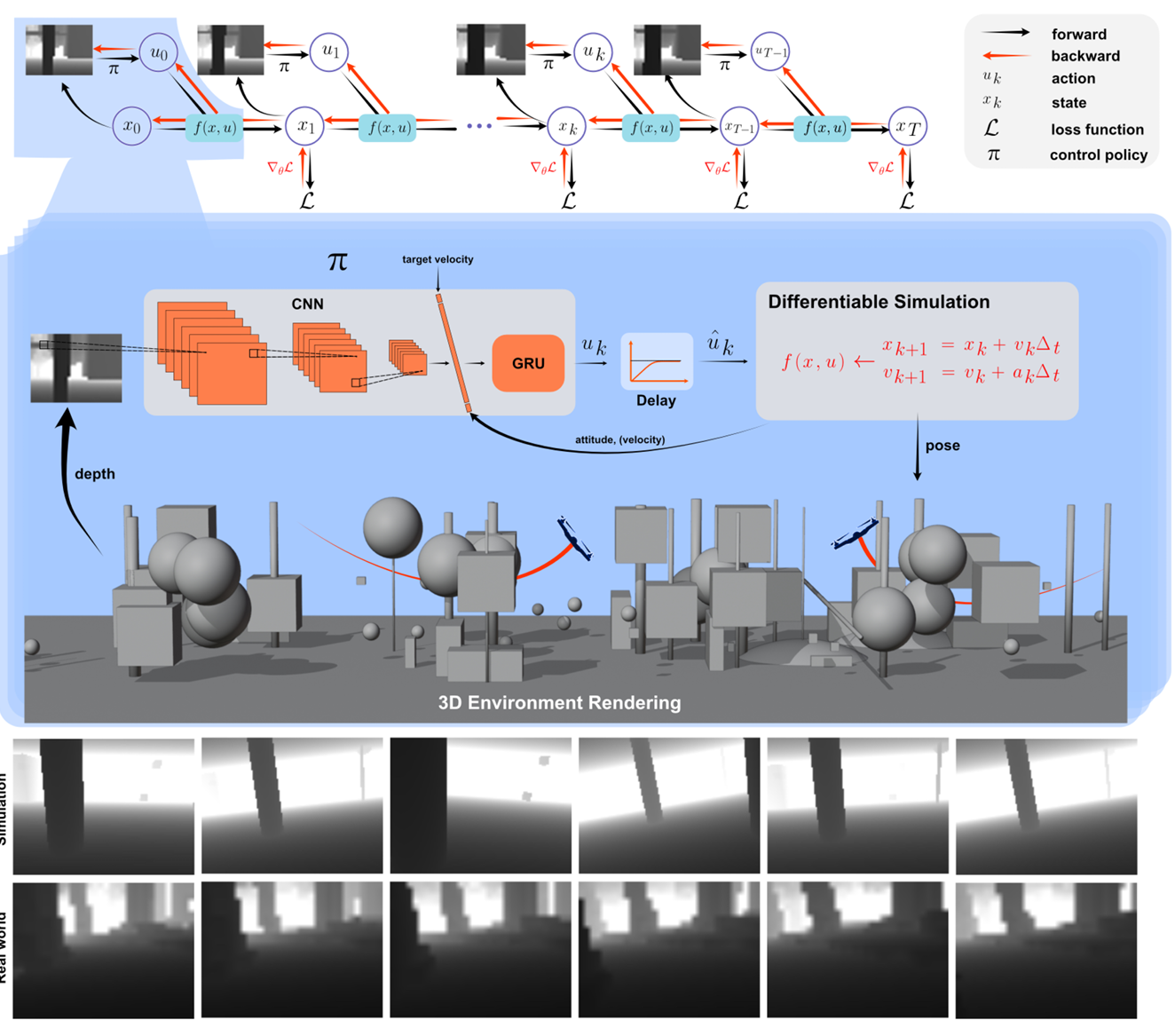

研究团队提出通过可微分仿真将深度学习与基于第一性原理的物理建模相结合,在仿真闭环中反向传播损失梯度,实现端到端的控制策略优化。

研究方法

可微分物理建模与仿真闭环训练

使用简化的点质量动力学模型建模无人机平移运动(非刚体建模),并显式引入推力延迟、空气阻力、控制平滑等因素;

该动力学模型是可导的(differentiable),用于在仿真中实现状态更新与梯度回传;

通过与深度图渲染组成的闭环仿真系统,策略网络在每一步感知输入后输出动作,损失函数可通过链式法则反向传播至策略参数。

图片来源:《Nature Machine Intelligence》(2025),论文“ Learning vision-based agile flight via differentiable physics”

基于物理结构的损失函数

- 损失函数由三部分构成:

① 速度跟踪项(参考目标速度);

② 避障项(基于最近障碍物距离和相对速度);

③ 控制平滑项(惩罚大幅度加速度/jerk); - 所有损失都是可导的连续函数,便于高效训练。

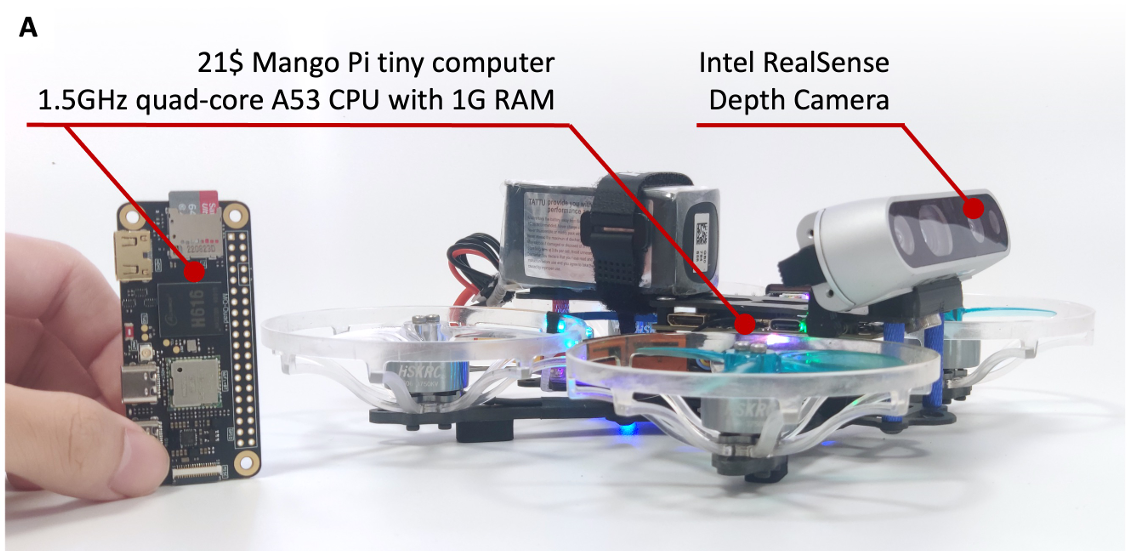

轻量级端到端控制

以倒置并池化到16×12的单通道深度图为输入,通过3层卷积+1层GRU进行时序建模,输出期望推力加速度 + 当前速度估计,偏航由目标方向自动对齐;

网络轻量化,可部署在无GPU、仅21美元的单板机(Mango Pi)上实时运行;

输入信息只需深度图 + 目标速度 + 姿态估计,无需使用VIO、GPS、VICON 等外部定位系统。

图片来源:《Nature Machine Intelligence》(2025),论文“ Learning vision-based agile flight via differentiable physics”

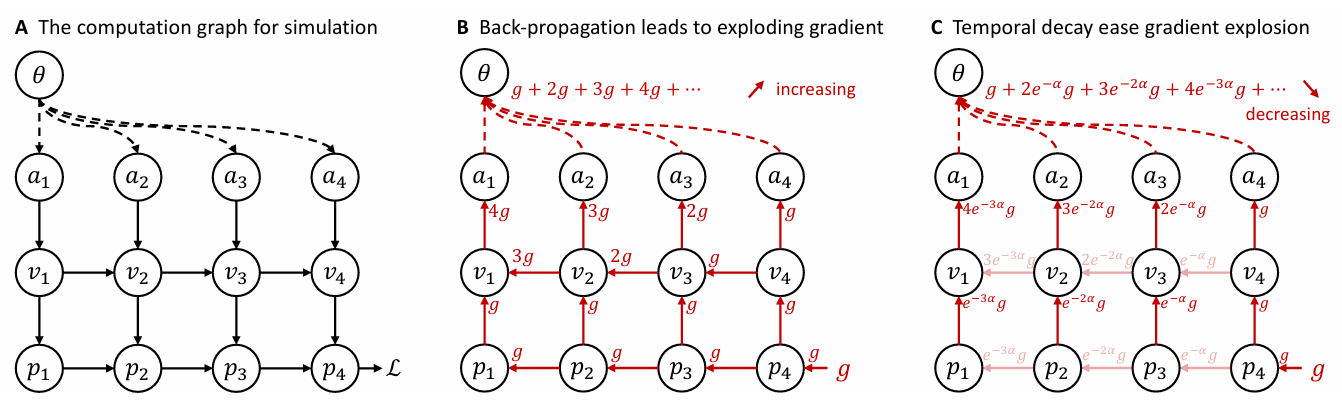

时间梯度衰减机制

为应对长序列反传可能导致的梯度爆炸,研究引入指数衰减系数,对时间步间梯度进行加权;

该机制让策略更关注“近未来”的可感知状态,有效提升训练稳定性与策略泛化能力。

图片来源:《Nature Machine Intelligence》(2025),论文“ Learning vision-based agile flight via differentiable physics”

实验测试

多场景真机实飞

在未知环境中(如密林、城市公园、室内走廊),进行高速避障飞行,验证算法泛化能力。

在森林中速度最高可达20m/s,城市/室内场景中可达7m/s。

在未知复杂环境中飞行保持高达90%的成功率,并能适应动态障碍物。

多机零通信协同换位测试

六架无人机以无通信方式完成“门口换位”任务:从门两侧出发,在中途交换位置。室内实测为每机提供速度估计使用了动捕,但不交换机间信息。

实测表示在互不通信、无集中规划的情况下,六架飞机成功出现等待、让行、跟随等自组织行为,完成了换位任务。

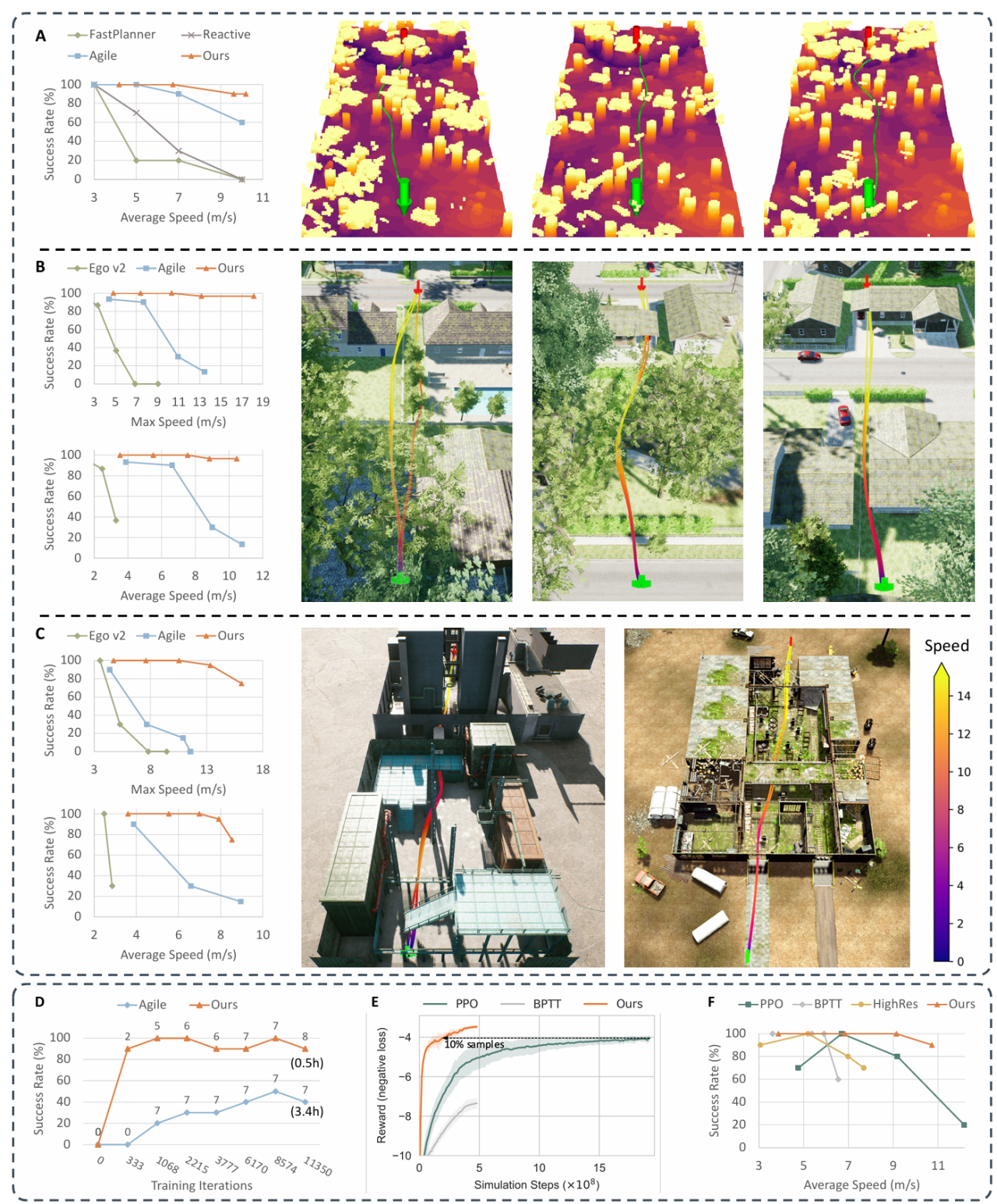

对比实验与消融分析

与PPO、Agile【1】等方法对比:在更少样本下达到相当或更好性能;在真机避障中展现出更强的鲁棒性。

关键机制验证:时间梯度衰减与低分辨率输入对收敛与泛化有效。

图片来源:《Nature Machine Intelligence》(2025),论文“ Learning vision-based agile flight via differentiable physics”

【1】:Loquercio, A. et al. Learning high-speed flight in the wild. Sci. Robot.*6, eabg5810 (2021).*

技术亮点

适应动态未知复杂环境,最高速度达20m/s

支持“零通信”的多机协同避障

训练效率高,样本需求低

低分辨率输入增强了现实泛化能力

低算力真机部署

论文信息:

第一作者张宇昂、胡瑜、宋运龙;通讯作者林巍峣、邹丹平

发表于《Nature Machine Intelligence》(五年影响因子 31.8)

资源速递

点击左下角阅读原文即可跳转论文链接

论文链接:

https://www.nature.com/articles/s42256-025-01048-0

开源代码:

https://github.com/HenryHuYu/DiffPhysDrone

如果您有感兴趣的技术话题,请在留言区告诉我们!关注阿木实验室,更多技术干货不断更新!

开发遇到棘手难题可以上阿木官方论坛:

有工程师亲自解答

10000+无人机开发者和你共同进步!